ACM的通信

面部识别软件的令人不安的未来

信用:瓦卢纳

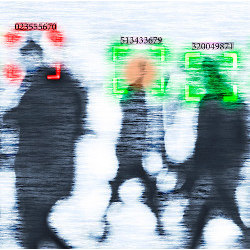

乔治奥威尔的小说1984年有一件事错了。随着STASI在德国的斯萨西,监督州不会有人们观看人们。电脑将成为观看人的人。技术让您以工业规模执行监视。

这在中国已经发生,法律执法正在使用面部识别软件,以捕捉相对较小的罪犯,例如Jaywalkers,以实现更加令人不安的活动,如跟踪Uyghurs。西方也看到了这种软件的崛起。例如,争议公司ClearView AI从网络上刮了大约30亿张照片,该公司用来向包括美国联邦调查局的机构销售面部识别服务。

幸运的是,推动力开始发生在这些发展中。2020年6月,IBM宣布将不再销售,研究或开发面部识别软件。亚马逊和微软迅速追随司机,宣布暂停向警方销售此类服务等待联邦监管。

美国的地方和国家政府正在击中暂停按钮。旧金山,波士顿和其他几个城市引入了禁令。据名字表明,民主立法者介绍了民主党立法者介绍的面部认可和生物公制技术暂停行为,暂停使用面部识别软件。ACM等专业社团以及包括人权观察和联合国在内的组织,也呼吁监管。

许多这些电话背后的重大伦理关注是偏见。在内的研究人员(包括MIT的Joy Buolamwini)已经证明了这项技术通常比女性更好地工作,比黑人更好,比黑人更好,最糟糕的是黑人女性。虽然某些面部识别软件在响应中得到改善,但仍然存在显着的偏见。2020年6月,在第一个已知的类型的情况下,底特律的一个男人在他的家庭面前被捕,因为他被面部识别软件错误地识别了他。它可能会因为这个男人是黑色而毫不奇怪。

但是,社会应该非常小心地呼吁暂停对使用面部识别软件的使用,因为这种偏见。当然,它是完全不可接受的,看由于偏差算法导致被监禁的黑人。但如果我们使用偏见作为要求监管的理由,我们就会在脚下射击自己。

有一天,面部识别软件可能比人类更少偏向。我们识别面孔的能力是高度变化的,具有重要的遗传部件,并且往往偏向于自己种族的人。因此,在人脸识别中击败人类不是一个高大的秩序。

有希望的话,如果有点缓慢,使面部识别软件更少偏见。这范围从使用更多代表性数据集(例如由大群体平衡的面部组成的10K美国的面部数据库)到脱叠方法(例如选择性地重新采样偏置数据以使其更少)。

有一天,就像下棋,阅读X射线或将口头普通话翻译成书面英语,因此电脑可能在面部识别方面容易地超越人类,并以比人类更少的偏见方式。此时,政府机构将在道德上有义务使用面部识别软件,因为它将比人类犯下更少的错误。

因此,禁止面部识别是有问题的。问题是它忽略了自动面部识别的许多其他危害可能会带来人们的生活。例如,该技术将挑战许多基本权利,例如隐私权和抗议权利。

美国的地方和国家政府正在击中暂停按钮。

此前,如果您在大量人群中抗议,请致敬,即气候应急或黑人生活,您就是匿名的。现在,软件可以实时识别您。例如,2018年,中国警察发现了一个音乐演唱会的罪犯,参加了60,000人使用一些面部识别软件。人的眼睛不能那样做。只有电脑眼睛可以。

当然,在使用面部识别软件时有益于。例如,在2018年,警方将这种软件进入新德里的孤儿院,并能够与父母一起团聚近3000名儿童。这是一个很好的好处。

有希望的话,如果有点缓慢,使面部识别软件更少偏见。

那我们怎么回事?许多人必须聚集在一起,决定如何浏览这个未来:伦理学家,技术人员,政客和社会学家,只有几个人的名义。监管可能是关键,我们已经看到了在公共设置中成功实施的禁令的示例。

面部识别软件的道德是复杂的。它始于与有关人员的明确同意,始于数据集的集合。然后它在许多问题上,从它在中国的UYGHURS这样的弱势群体中,以良好和不良用途的技术困境。

面部识别可能是AI极大地解决我们的首次用途之一。但这不是最后的。最终,这是关于我们将发明的世界。所有社会必须从事这一辩论。

数字图书馆由Computing Machinery协会发布。版权所有©2022 ACM,Inc。

没有发现任何条目