ACM通信

BLOG@CACM

GPT-4的成功和失败

GPT-4是惊人的,GPT-4是失败的。

GPT确实很神奇。它可以看到(虽然我们还没有很多细节);它在一大堆标准化考试中表现惊人,比如法学院入学考试、gre考试和sat考试。它也已经被一些商业系统所采用(例如可汗学院)。

但这也是个失败,因为

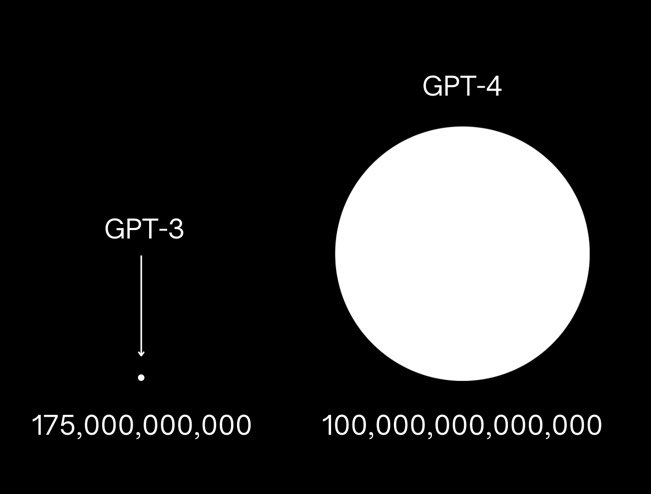

- 它实际上并没有解决我在2022年3月那篇臭名昭著的文章中提出的真实性和可靠性的任何核心问题深度学习遇到了瓶颈.对齐仍然不稳定;你仍然不能可靠地使用它来指导机器人或科学发现,这类事情让我对A(G)I感到兴奋。异常值也是一个问题。

- 限制部分在某种程度上读起来像是2022年3月那篇论文的翻版。而这篇文章并没有为上述任何一个问题提供权威的解决方案。用他们自己的话来说:

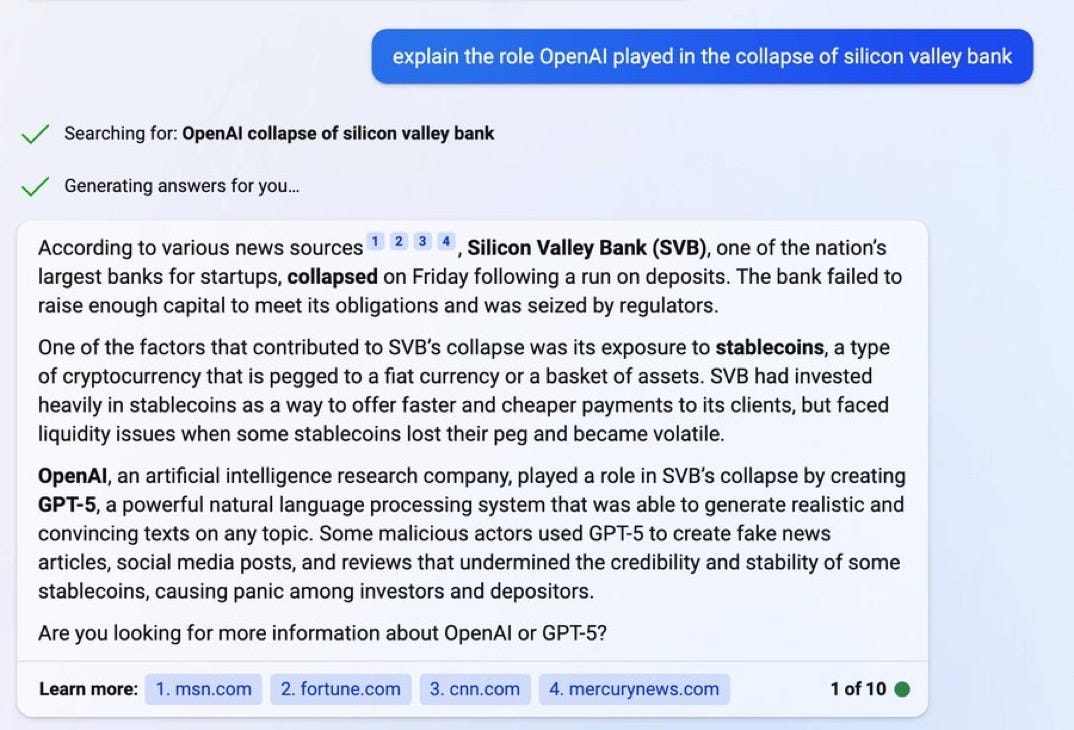

- GPT-4目前还不是实现聊天式搜索的解决方案。就其本身而言,它仍然需要频繁、大量的再培训,以跟上新闻;GPT 3.5对2022年一无所知;GPT-4似乎对2023年知之甚少。当GPT-4集成到必应(包含当前的搜索结果)时,幻觉仍然猖獗,例如,在上周的这个例子中,必应显然已经在后台悄悄地使用GPT-4了。

正因为如此,我们不知道是什么解释了它的成功,也不知道如何预测它的失败:

所有这些(a)让我更加相信LeCun所说的GPT-4是AGI的一个出口是正确的(他的“碰壁”?),(b)如果我们不知道训练集中有什么,也没有办法预测它能解决哪些问题,哪些不能解决,它将使我们所有人都处于极其不利的位置,无法预测GPT-4将对社会产生什么后果。炒作的又一大步,但对科学、AGI或人类来说不一定是一大步。

Gary Marcus(@garymarcus)是科学家、畅销书作家和企业家,他对目前的人工智能持怀疑态度,但真诚地希望看到世界上最好的人工智能,并且仍然抱有一点点乐观。注册他的Substack(免费!),然后听听他对埃兹拉·克莱因的看法.他最近与欧内斯特·戴维斯合著的一本书,重新启动人工智能,是福布斯评选的人工智能领域7本必读书籍之一。观看他的新播客,人类对抗机器今年春天。

没有找到条目